- 畅销套餐

- 精选套餐

- 课程介绍

- 课程大纲

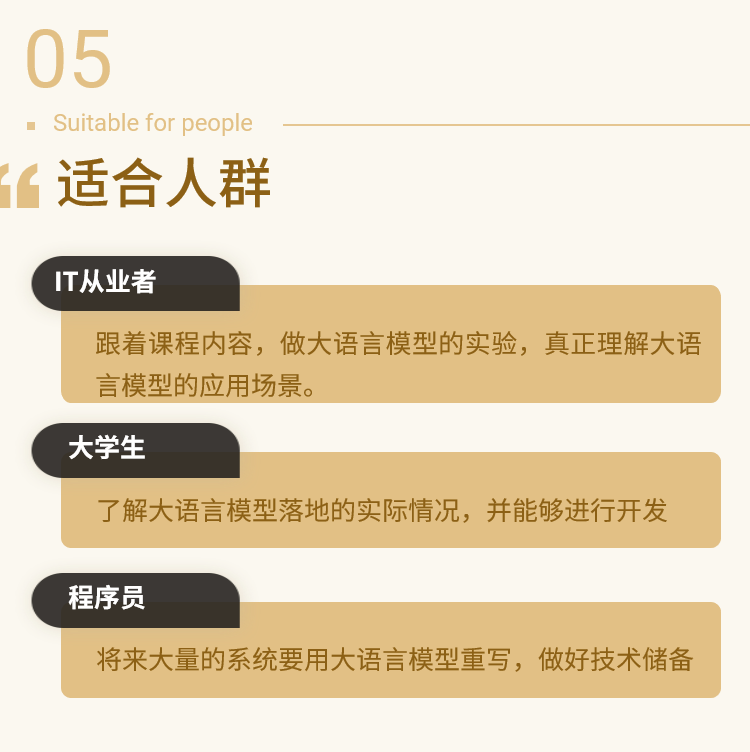

适合人群:

IT从业者 跟着课程内容,做大语言模型的实验 ,理解大语言模型的应用场景。 大学生 了解大语言模型落地的实际情况,并能够进行开发 程序员 为将来大量的系统要用大语言模型重写,做好技术储备

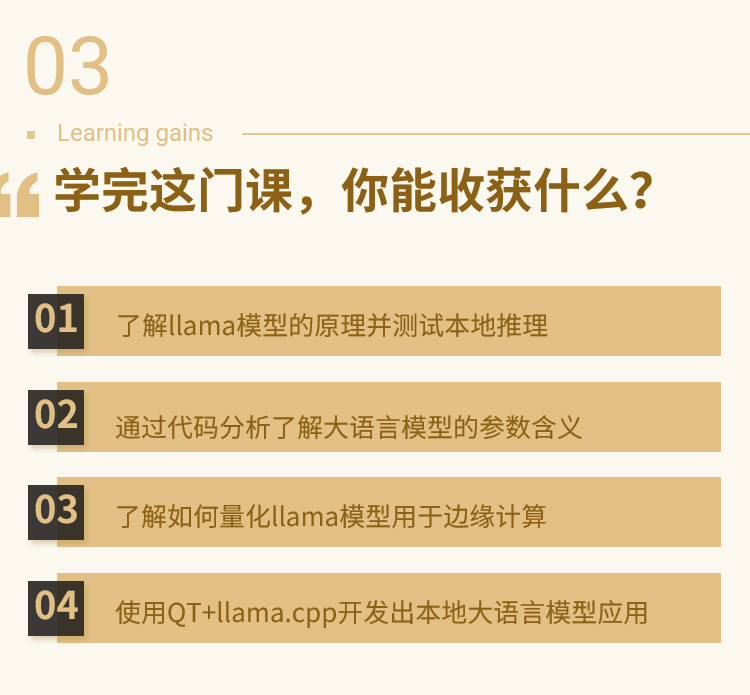

你将会学到:

能够开发本地推理的AI大语言模型

- 了解llama模型的原理并测试本地推理

- 合并llama与开源中文模型

- 通过代码分析了解大语言模型的参数含义

- 了解如何量化llama模型用于边缘计算

- 使用QT+llama.cpp开发出本地大语言模型应用

课程简介:

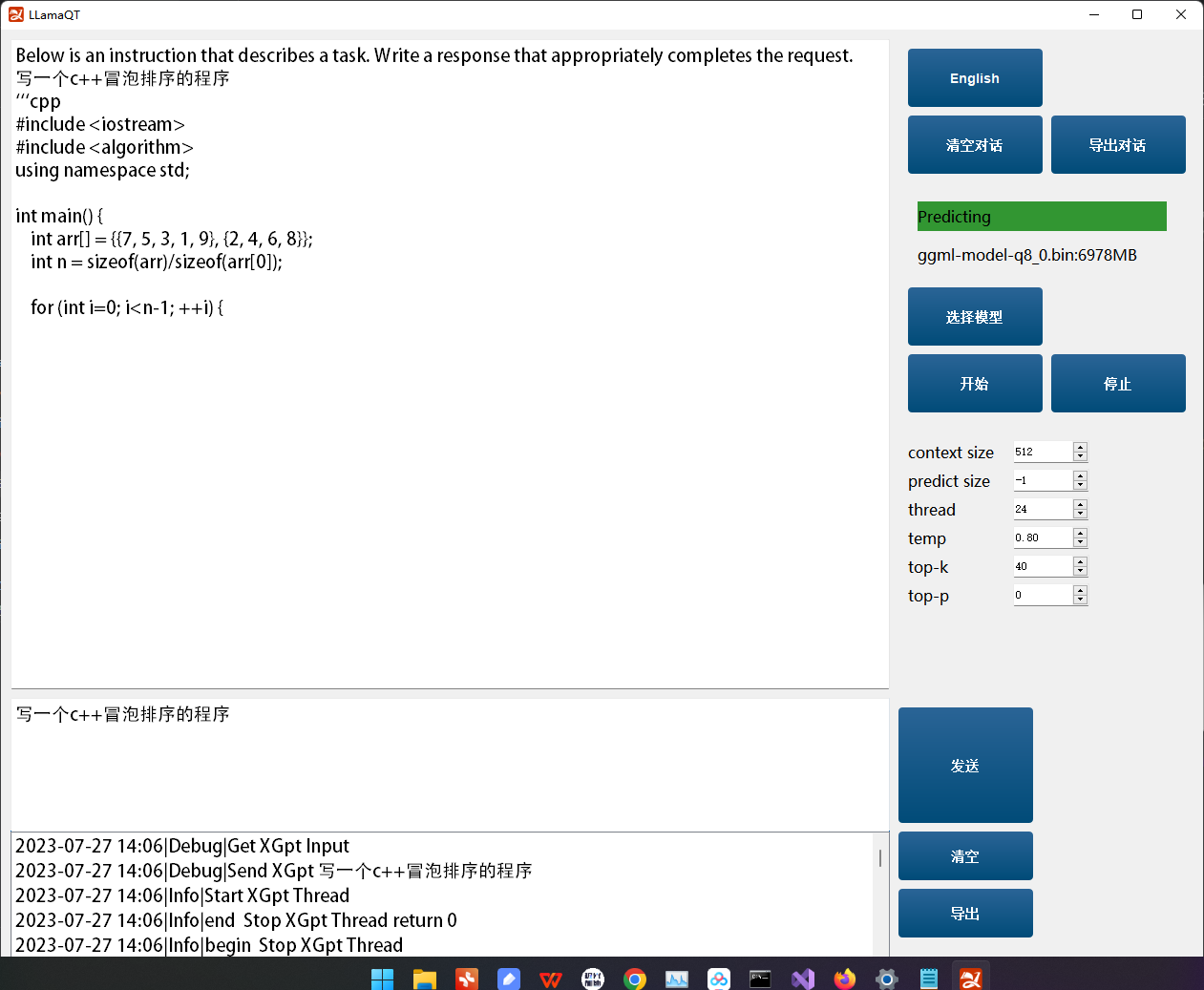

课程内容展示

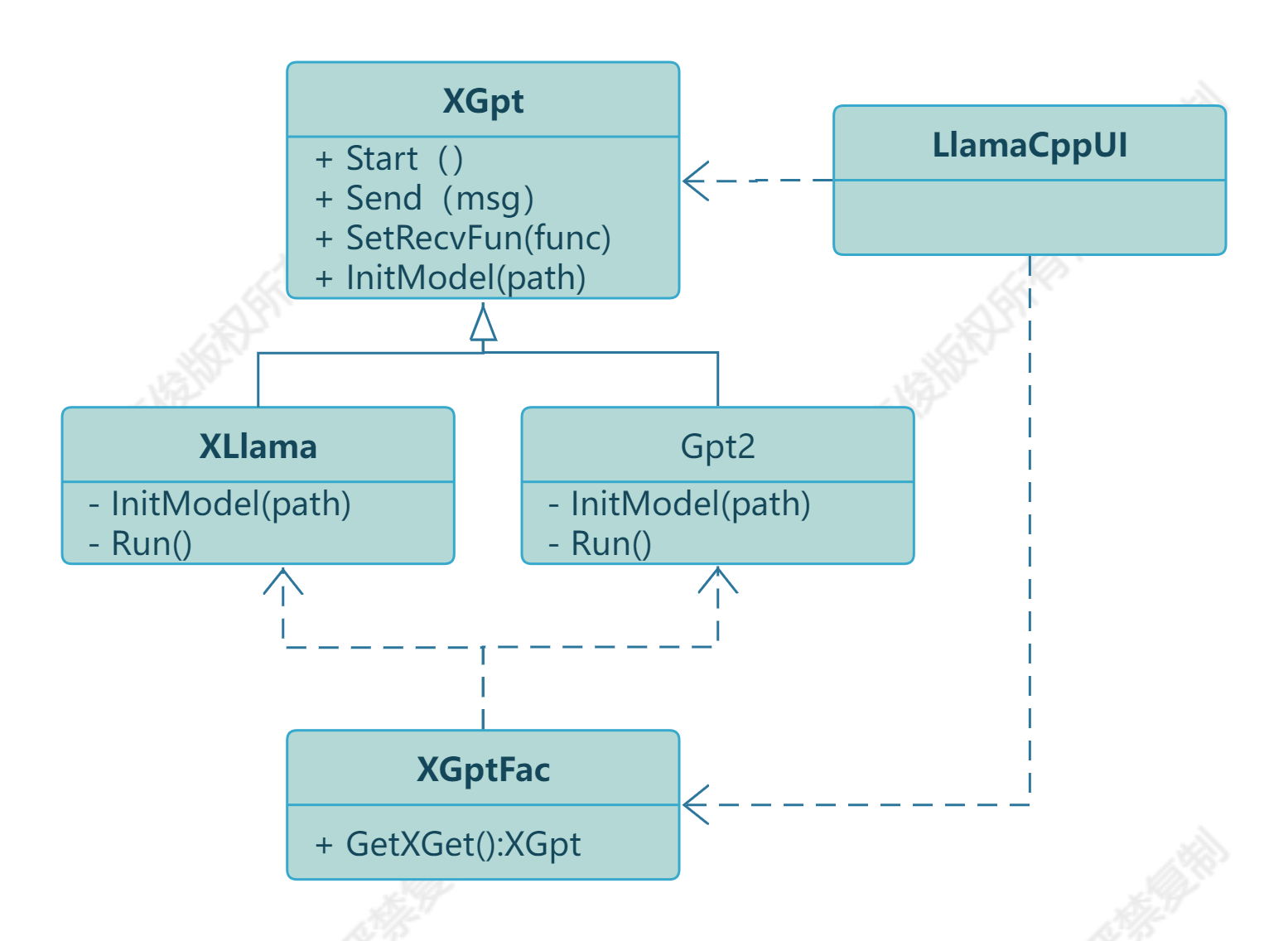

1 XGpt模块设计

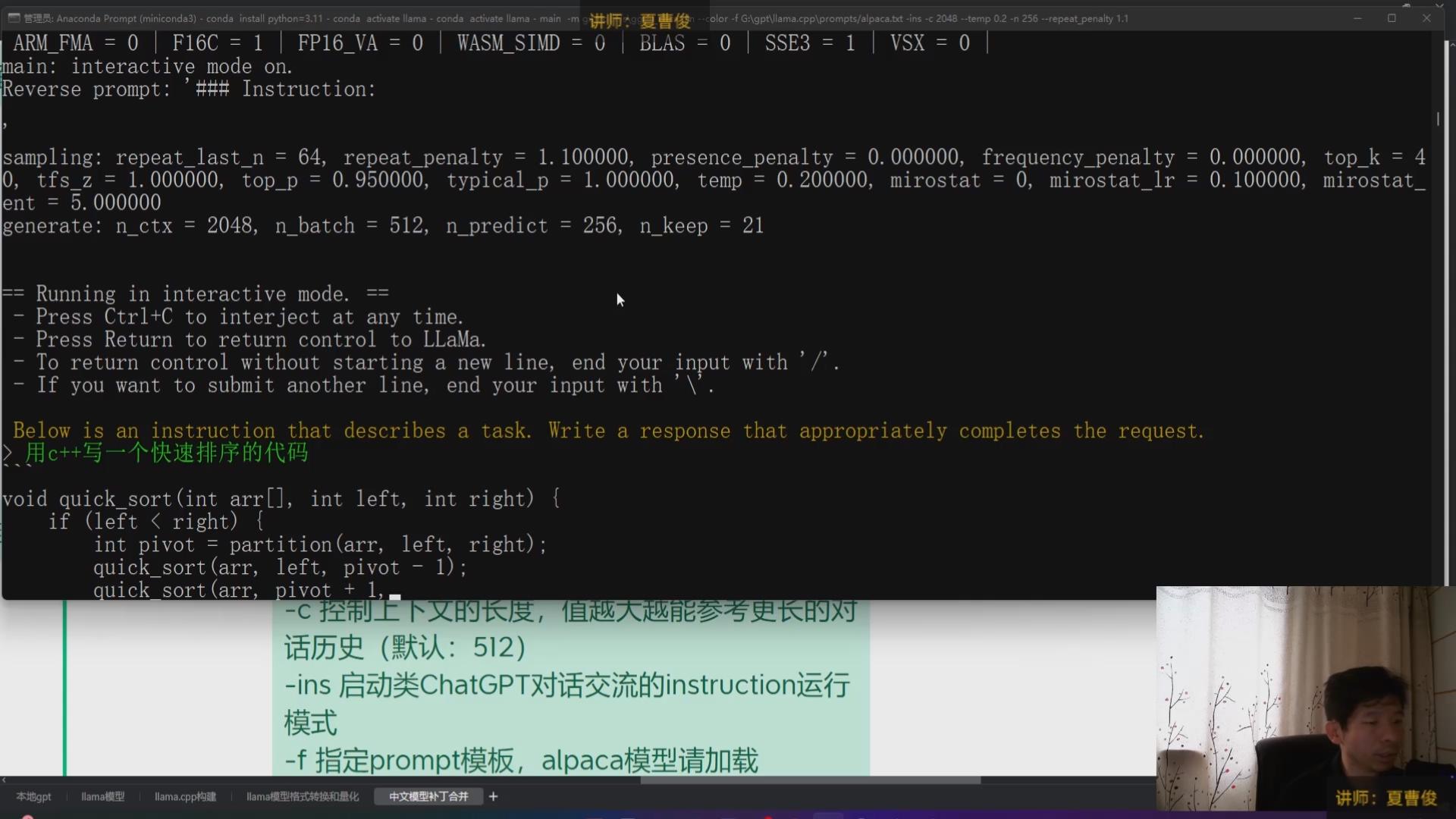

2 llama.cpp 控制台推理程序

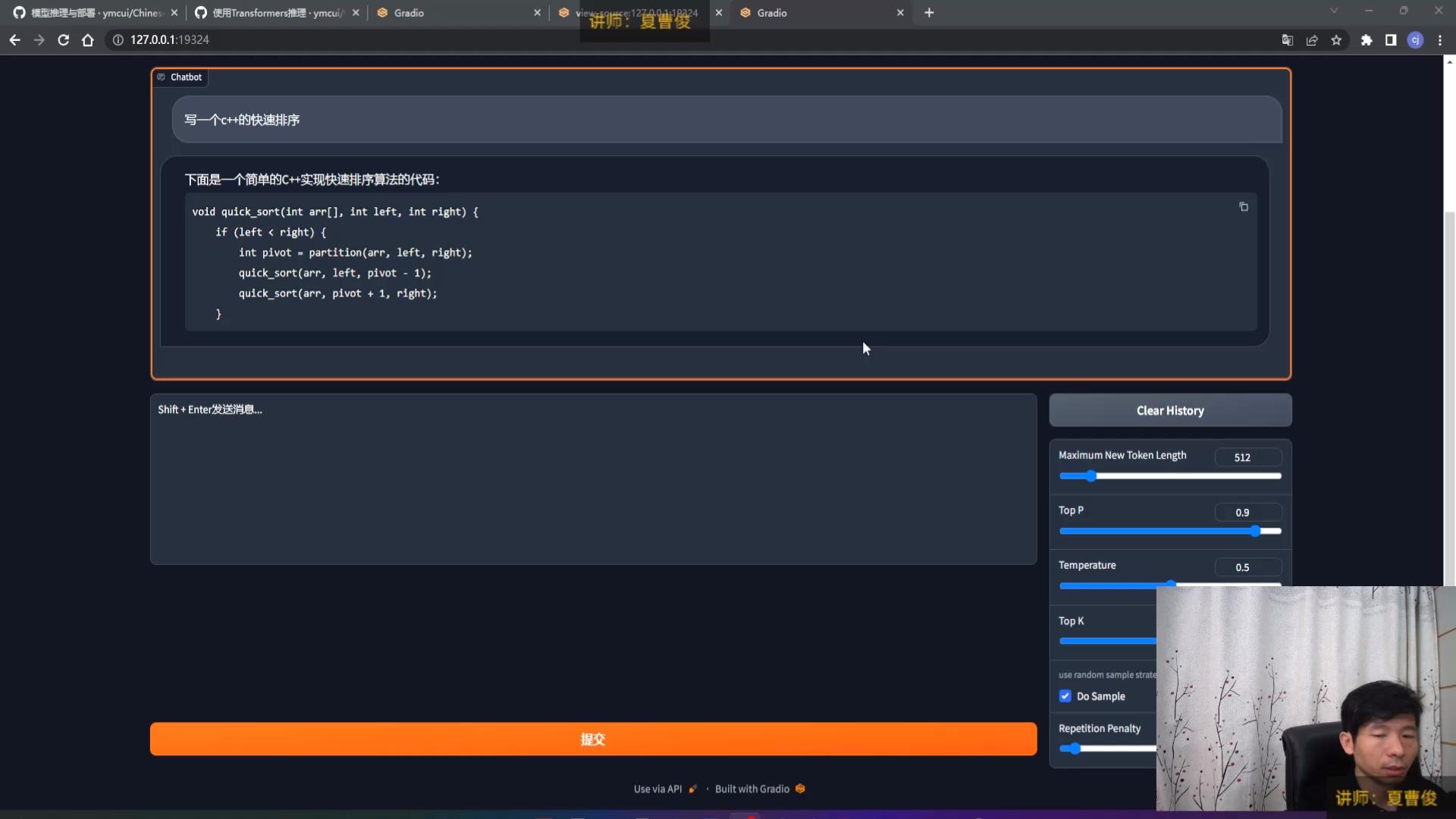

3 基于transformer的推理

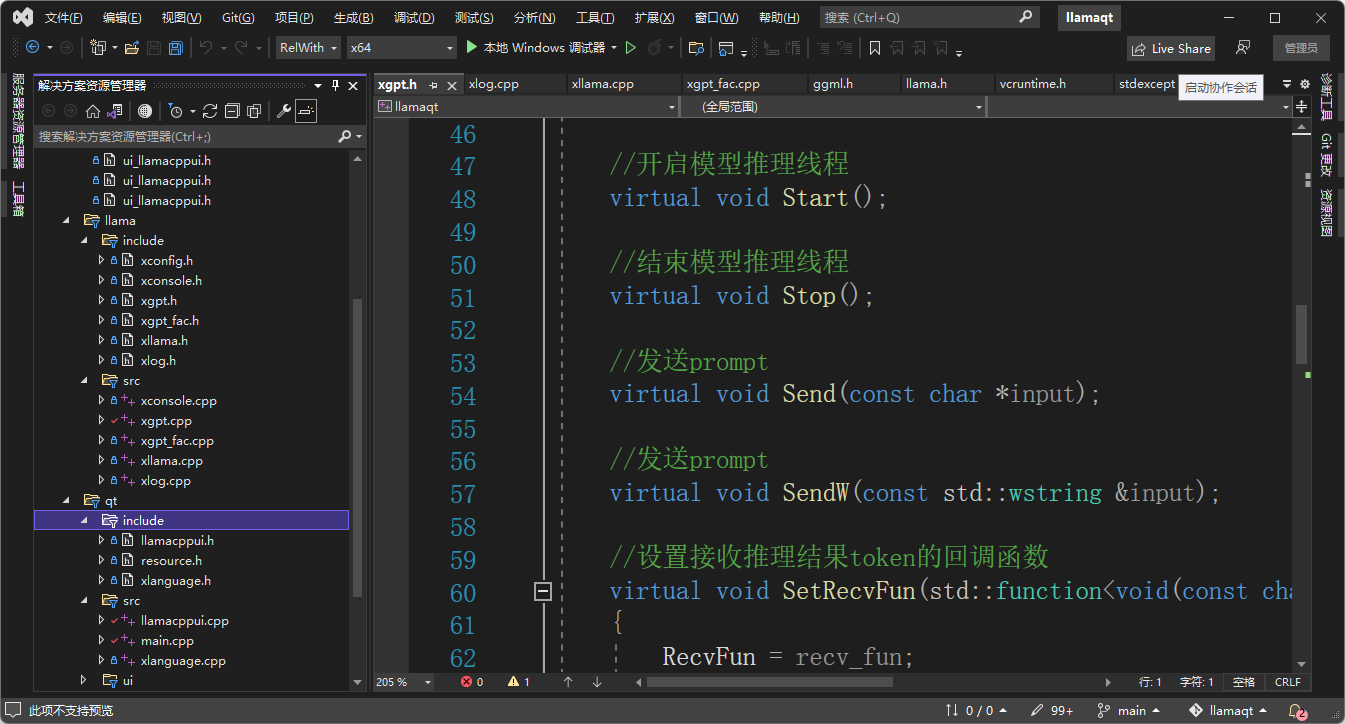

4 可视化推理程序llamaqt代码

5 可视化推理程序llamaqt

课程大纲

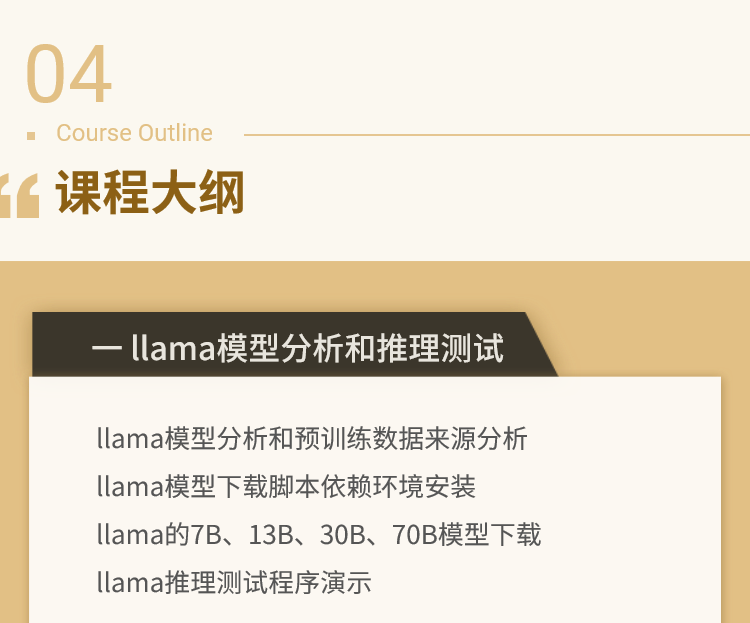

一 llama模型分析和推理测试

llama模型分析和预训练数据来源分析

llama模型下载脚本依赖环境安装

llama的7B、13B、30B、70B模型下载

llama推理测试程序演示

二 llama.cpp构建

llama.cpp源码下载和构建环境分析

构建依赖VisualStudio2022安装

构建依赖CMake安装

llama.cpp在windows构建和项目分析

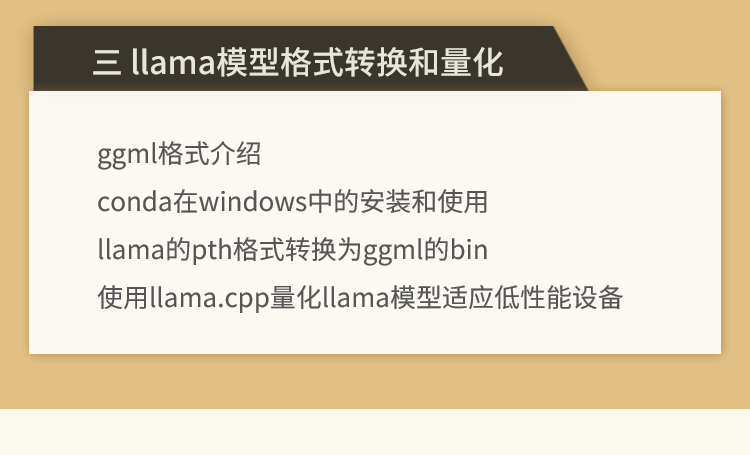

三 llama模型格式转换和量化

ggml格式介绍

conda在windows中的安装和使用

llama的pth格式转换为ggml的bin

使用llama.cpp量化llama模型适应低性能设备

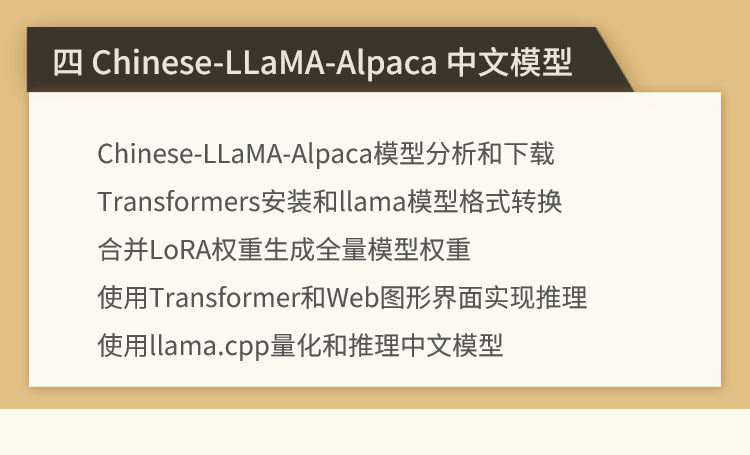

四 Chinese-LLaMA-Alpaca 中文模型

Chinese-LLaMA-Alpaca模型分析和下载

Transformers安装和llama模型格式转换

合并LoRA权重生成全量模型权重

使用Transformer和Web图形界面实现推理

使用llama.cpp量化和推理中文模型

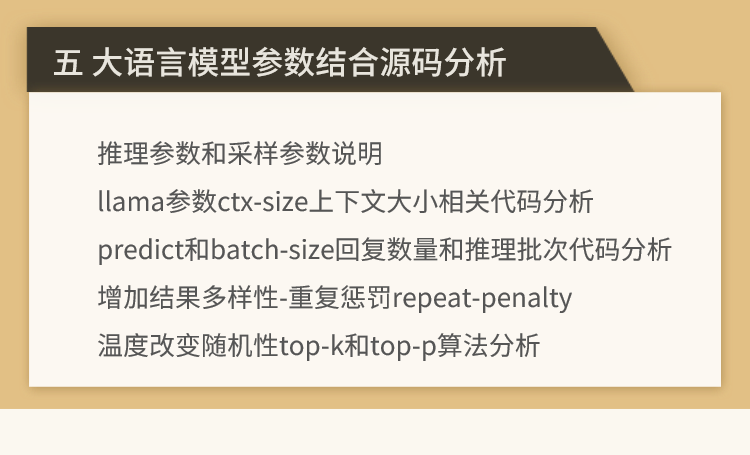

五 大语言模型参数结合源码分析

推理参数和采样参数说明

llama参数ctx-size上下文大小相关代码分析

predict和batch-size回复数量和推理批次代码分析

增加结果多样性-重复惩罚repeat-penalty

温度改变随机性top-k和top-p算法分析

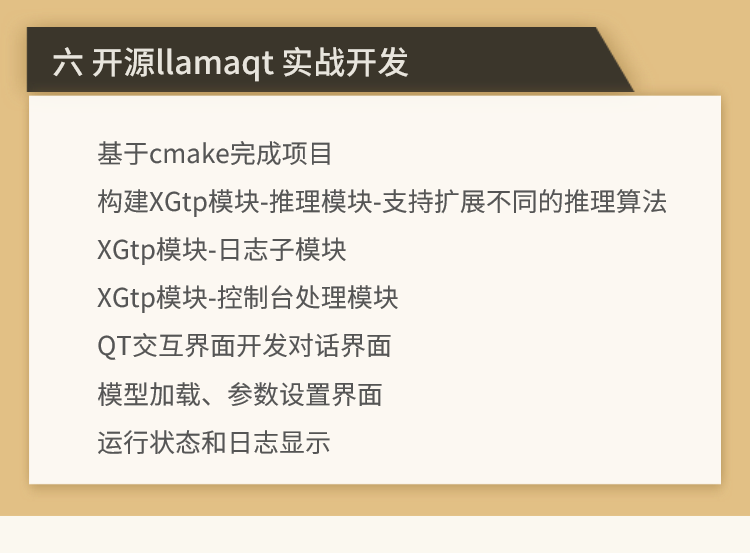

六 开源llamaqt 实战开发

基于cmake完成项目构建

XGtp模块-推理模块-支持扩展不同的推理算法

XGtp模块-日志子模块

XGtp模块-控制台转发模块

QT交互界面开发对话界面

模型加载、参数设置界面

运行状态和日志显示

常见问题:

问:我没有3090和A100显卡是否能运行本门课程示例

答:跟着课程做实验电脑有什么要求。内存32G就够,CPU越快越好, 显卡N卡和A卡都可以加速,不是必须

问:课程示例对操作系统有什么要求

答:课程所有的示例都在Windows11上运行,但所有代码和工具都是支持Linux和Mac

问:我没有C++和QT基础可不可以学习本门课程

答:除了最后一章开发实战需要C++和QT其他章节不需要,可以先学习前面章节,理解大语言模型本地推理的实际情况

课程大纲-LLama实战本地CPU推理大语言模型-C++开发实战

第1章课程介绍(11分钟2节)

第2章llama模型下载和推理测试(37分钟4节)

第3章llama.cpp源码编译(38分钟4节)

第4章llama模型格式转换和量化(41分钟5节)

第5章Chinese-LLaMA-Alpaca 中文模型(1小时12分钟5节)

5-1

Chinese-LLaMA-Alpaca 中文模型分析和下载

「仅限付费用户」点击下载“Chinese-LLaMA-Alpaca 中文模型_20230721113429.pdf”

[13:22]开始学习

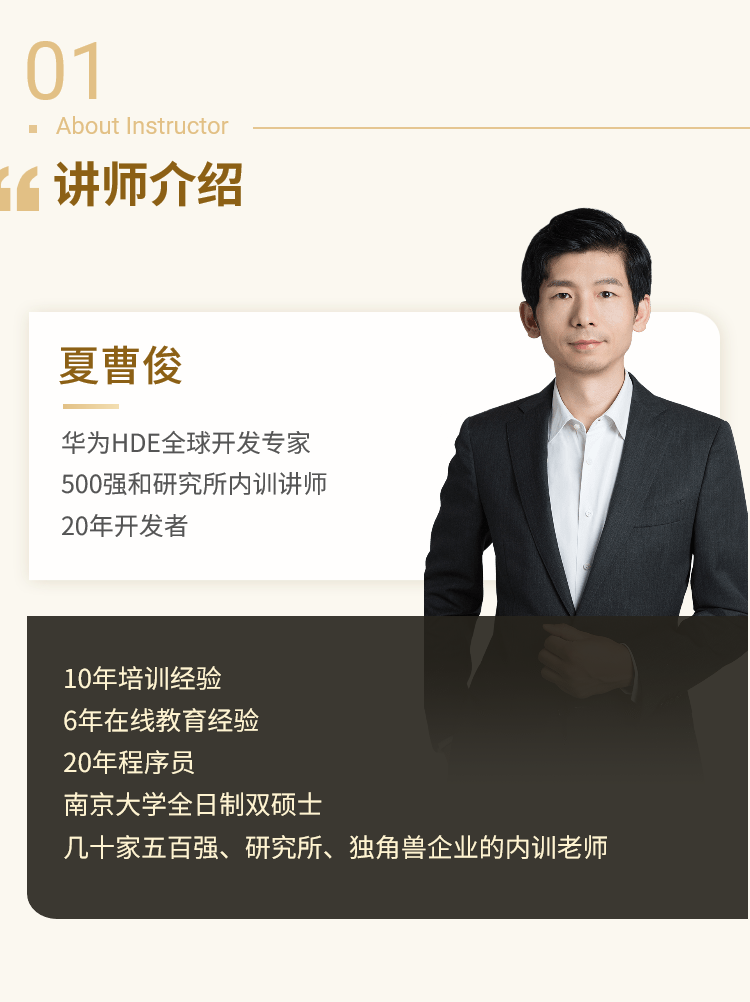

“夏曹俊”老师的其他课程更多+

下载学堂APP缓存视频离线看

下载学堂APP缓存视频离线看