- 畅销套餐

- 精选套餐

- 人气套餐

- 尊享套餐

- 高薪套餐

- 课程介绍

- 课程大纲

适合人群:

适合有一定基础的大数据学员。

你将会学到:

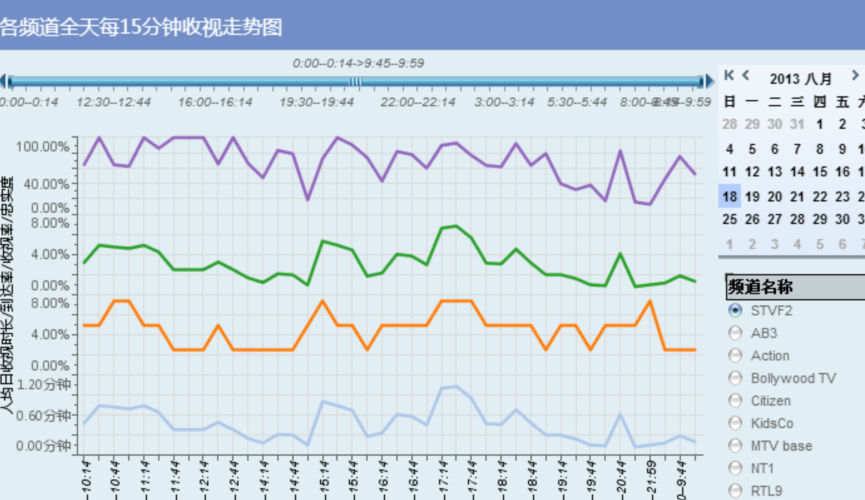

项目案例是国内的一家广电企业作为非洲国家的一个运营商,以用户收视行为数据作为基础数据,通过对频道和节目的分析,采用多维度统计分析的方法挖掘用户的收视行为特征。通过此案例可以学习大数据整体开发流程,课程是围绕一个大数据整理流程而做的教学课程,学完此课程可以企业流程做一个整体的认识。

课程简介:

本案例是国内的一家广电企业作为非洲国家的一个运营商,以用户收视行为数据作为基础数据,通过对频道和节目的分析,采用多维度统计分析的方法挖掘用户的收视行为特征。用以指导并辅助产品运营、用户增值消费导向、广告投放及节目和频道质量的把控,提升用户的粘度提供参考依据,针对卢旺达地区的收视行为做出了分析,并根据分析结果提出了一系列措施来吸引当地用户,提高收视率。

通过此案例可以学习大数据整体开发流程,课程是围绕一个大数据整理流程而做的教学课程,让大家明白大数据不同技术的相互协调,从收集数据,过滤数据,数据分析,数据展示,

调度的使用而开发的课程,而且怎么从hadoop,hive应用快速的过度到spark上面而做的整套流程。学完此课程可以企业流程做一个整体的认识。

分布式集群环境搭建

Linux 搭建

hadoop安装(4台机器)

hive安装

flume 安装

sqoop 安装

Azkaban安装

php搭建

第01节:项目的简介

第02节:项目的背景

第03节:项目流程演示

第04节:讲课的内容和对应的知识点

第05节:php展示统计分析之后的数据

第06节:大数据架构介绍并且企业使用的测试集群环境和人员配置

第07节:VM的安装

第08节:centos的安装和网络配置

第09节:通过第三方连接centos的方法

第10节:CentOS的yum源更新已经关闭防火墙

第11节:JAVA的安装和hadoop安装

第12节:完全分布式搭建(上)

第13节:完全分布式搭建(下)

第14节:通过hadoop自带的demo运行单词统计

第15节:写一个sh脚本,可以通过一台机器控制多台机器

第16节:hadoop常用的命令简单介绍

第17节:MAPREDUCE 示例编写及编程规范

第18节:安装时间同步工具,让所有电脑进行同步

第19节:Hive简介和工作流程

第20节:Mysql的安装,centos7安装mysql注意点

第21节:安装Hive,并且使用Hive做一个小案例

第22节:把txt文件的数据导入到Hive表中

第23节:Flume采集系统结构图

第24节:Flume的安装部署和实战

第25节:sqoop数据迁移和安装

第26节:sqoop数据从hadoop里面导入到mysql里面

第27节:sqoop数据从mysql里面导入到hadoop里面

第28节:Azkaban介绍和安装

第29节:Azkaban创建SSL配置和配置文件

第30节:Azkaban实战通过5个不同场景介绍原理

第31节:电视采集项目流程篇之通过linux日志收集数据到hdfs上面

第32节:电视采集项目流程篇之通过MAPREDUCE 把收集数据进行清洗

第33节:电视采集项目流程篇之清洗数据绑定到hive表中(上)

第34节:电视采集项目流程篇之清洗数据绑定到hive表中(下)

第35节:电视采集项目流程篇之根据hive绑定数据统计计算保存到hive表中

第36节:电视采集项目流程篇之把hive表中数据导入到mysql中

第37节:电视采集项目流程篇之安装php环境并且快速熟悉php语法

第38节:电视采集项目流程篇之安装php和echarts进行结合展示图表

第39节:电视采集项目流程篇之Azkaban调度脚本的编写

第40节:电视采集项目流程篇之Azkaban流程调度演示,最终在php页面展示

第41节:hadoop和hive项目怎么平滑的转到spark上面介绍

第42节:spark的安装和使用

第43节:Spark整体架构

第44节:transformation和action介绍

第45节:Spark SQL和DataFrame

第46节:电视采集项目流程spark篇通过sparksql处理业务逻辑上

第47节:电视采集项目流程spark篇通过sparksql处理业务逻辑下

第48节:电视采集项目流程spark篇通过Azkaban调度spark

第49节:项目总体总结

第50节:简历指导

课程大纲-大数据分析电视收视率项目实战教程(Hadoop、Hive升级Spark技术)

“猿课教育”老师的其他课程更多+

下载学堂APP缓存视频离线看

下载学堂APP缓存视频离线看