Transformer的Transformer类代码解读

Transformer发轫于NLP(自然语言处理),并跨界应用到CV(计算机视觉)领域。目前已成为深度学习的新范式,影响力和应用前景巨大。

本课程对Transformer的原理和PyTorch及TensorFlow 2代码进行精讲,来帮助大家掌握其详细原理和具体实现。

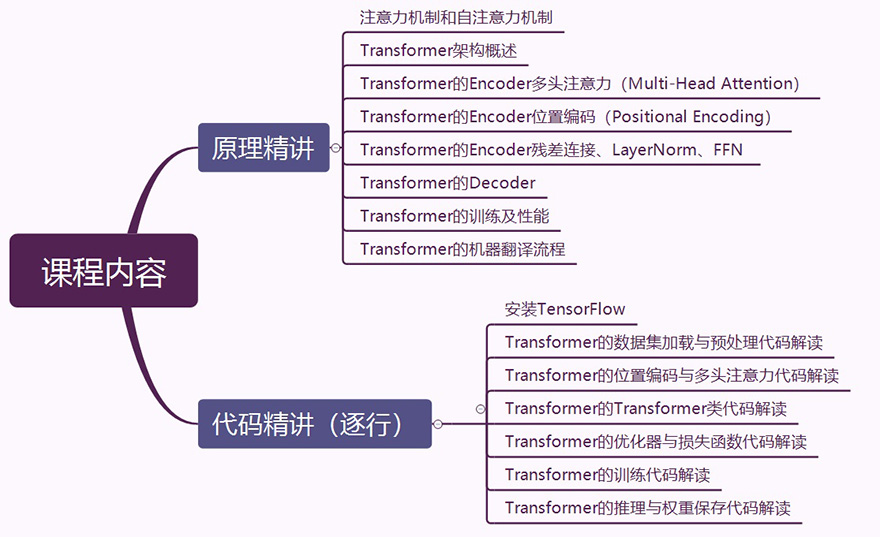

原理精讲部分包括:注意力机制和自注意力机制、Transformer的架构概述、Encoder的多头注意力(Multi-Head Attention)、Encoder的位置编码(Positional Encoding)、残差链接(Residual Connection)、层规范化(Layer Normalization)、FFN(Feed Forward Network)、Transformer的训练及性能、Transformer的机器翻译工作流程。

代码精讲部分使用Jupyter Notebook对Transformer的PyTorch及TensorFlow 2实现代码进行逐行解读,包括:安装PyTorch/TensorFlow、Transformer的数据集加载与预处理代码解读、Transformer的位置编码与多头注意力代码解读、Transformer的Transformer类代码解读、Transformer的优化器与损失函数代码解读、Transformer的训练代码解读、Transformer的推理与权重保存代码解读。

公开笔记对他人可见,有机会被管理员评为“优质笔记”

{{ noteEditor.content.length }}/2000

讲师收到你的提问会尽快为你解答。若选择公开提问,可以获得更多学员的帮助。

课程大纲

- 第一章 课程介绍

- 1-1试看 课程介绍15:21

- 第二章 Transformer原理精讲

- 2-1注意力机制和自注意力机制33:19

- 2-2Transformer的架构概述11:22

- 2-3Transformer Encoder的多头注意力15:37

- 2-4Transformer Encoder的位置编码10:03

- 2-5Transformer 残差链接、LayerNorm、FFN06:15

- 2-6Transformer Decoder06:29

- 2-7Transformer的训练及性能09:59

- 2-8Transformer的机器翻译工作流程04:23

- 第三章 Transformer代码精讲(Pytorch)

- 3-1安装pytorch08:31

22课时

22课时 19课时

19课时 20课时

20课时 18课时

18课时 11课时

11课时 114课时

114课时 36课时

36课时 4课时

4课时